AI去衣技术争议不断:网络空间的伦理红线该谁来守

最近,某款号称"一键精修"的AI图像工具频繁登上热搜。用户上传穿着夏日裙装的照片后,画面中裙子边角若隐若现的变化,让不少人直呼意外。这种依赖深度学习算法的图像处理技术,在提升视觉效果的同时,也悄然挑战着网络空间的边界。

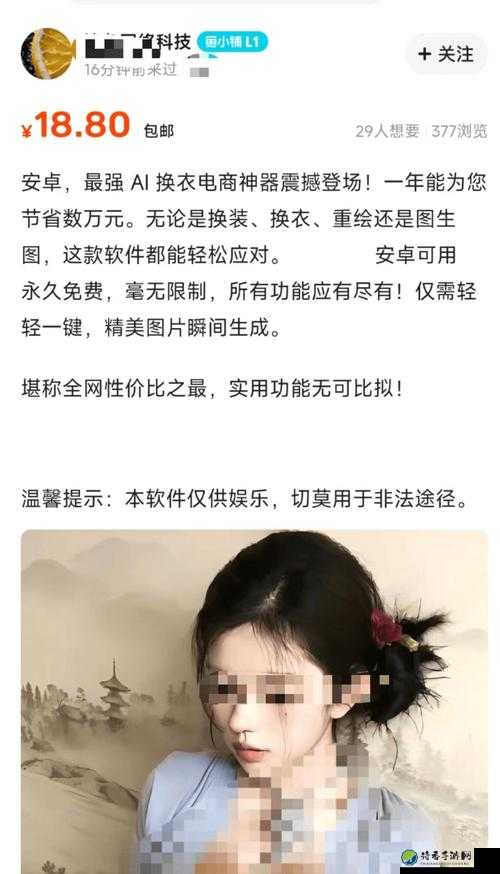

技术进步带来的便利显而易见。AI图像处理正在重塑设计、医疗等领域的作业流程,甚至能让普通用户轻松制作专业级的视觉作品。但当算法开始深度解析人体特征,原本中性的技术工具就容易滑向争议的深水区。某款标榜"智能剪裁"的应用程序,因其生成结果中人物衣着覆盖范围的异常变化,仅上线72小时就被强制下架。

技术与的攻守战

1. 算法决策的黑箱之困

深度学习模型通过海量样本训练出的特征识别能力,在面料材质、人体轮廓等细节处理上展现出惊人精度。但当模型需要判断"适度"的界限时,简单的人工设定往往难以覆盖复杂场景。某次算法优化后,系统将防晒帽判定为"可替换物品",导致多位用户上传的照片出现帽子自动消失的尴尬现象。

2. 用户认知的错位鸿沟

面对标注为"智能修图"的选项,不同年龄层的用户产生完全不同的理解。一位23岁的大学生兴奋地分享"AI给了我滤镜自由",而一位45岁的家庭主妇却在社交媒体质问"为何我的泳装照会自动生成破洞效果"。这种认知差异正在不断扩大技术开发者与普通用户的隔阂。

3. 平台监管的动态博弈

监管部门普遍采用"出现问题再补救"的被动模式,导致技术边界频繁突破。某平台因"透视滤镜"被勒令整改后,仅仅两个月就推出改头换面的"动态光影"功能。这种"猫捉老鼠"的监管困局,暴露出法律法规与技术迭代速度之间的严重脱节。

数字空间的文明之堤

建立多层次防护机制

除了事后封禁,更需要事前预防的保护网。丹麦某图像平台采用的"三重验证"模式值得借鉴:算法侧设置可解释性开关,用户端提供视觉确认窗口,管理端建立动态警示库。这种立体防护体系让技术既保持创新活力,又不偏离正向轨道。

培育数字时代的审美共识

技术从来都是文化表达的新载体。韩国的像素艺术社区、中国的非遗数字传承项目,都证明算法可以成为传递人文价值的工具。我们需要引导技术开发者建立美学共同体,让深度学习模型学会识别文化差异,而不是简单复制主流审美标准。

构建智能化监督网络

通过部署实时检测系统,可以在生成内容发布前进行多模态交叉验证。当检测到图像特征点异常跳动,系统会自动调用不同算法组合进行二次确认。这种去中心化的监督网络,能够有效弥补人工审查的漏洞。

通向人性化的技术进化

技术本无善恶,关键在于掌握方向盘的手。当算法开始学习人体特征曲线时,我们需要让它同时吸收社会契约的精神内核。让每行代码都携带人文温度,才能真正实现技术与文明的共进。站在智能图像处理的新起点,每一位开发者都应该问问自己:我们是想创造更好的工具,还是只想满足某些特定场景的需求?

数字文明的浪潮不会停歇,但守护人性尊严的堤坝必须筑得更高更牢。只有技术发展始终与价值导向同频共振,才能避免算法异化的宿命。这不仅关乎网络空间的清朗,更关系到人类文明能否在智能时代保持精神高度。让我们携手构建一个既充满创新活力,又不失温度的技术生态,让数字世界的每一帧画面都传递真善美的力量。